- 博客

- Gemini 3 Flash:为速度而生的前沿智能

Gemini 3 Flash:为速度而生的前沿智能

Gemini 3 Flash 在“速度—智能”这条传统权衡曲线上开辟了新空间:以更低延迟和更低成本,提供前沿级的推理与多模态能力。它已成为 Gemini 应用与搜索 AI 模式的默认模型,开发者也可在谷歌全栈工具链中使用。

目录

速览

Gemini 3 Flash 的目标是“更快、更省、更聪明”。核心要点:

- 前沿级推理:GPQA Diamond 90.4%,Humanity’s Last Exam 33.7%(无工具),MMMU Pro 81.2%(与 Gemini 3 Pro 相当)。

- 相比以往型号更高效:基准显示其相对 Gemini 2.5 Pro 提速约 3 倍(基于第三方测试),在典型流量下完成日常任务时平均减少约 30% 的 Token 消耗,同时保持更高表现。

- 针对交互应用、编码、复杂分析与多模态理解优化。

- 已在 Gemini 应用与搜索 AI 模式默认启用,面向全球用户免费开放。

- 开发者可通过 Google AI Studio、Google Antigravity、Gemini CLI、Android Studio、Vertex AI 与 Gemini Enterprise 使用。

为什么值得关注

Flash 系列一贯强调响应速度。Gemini 3 Flash 在此基础上兼顾前沿推理能力与成本/延迟控制,支撑近乎实时的助手、设计到代码流水线,以及可用于生产的编码代理。

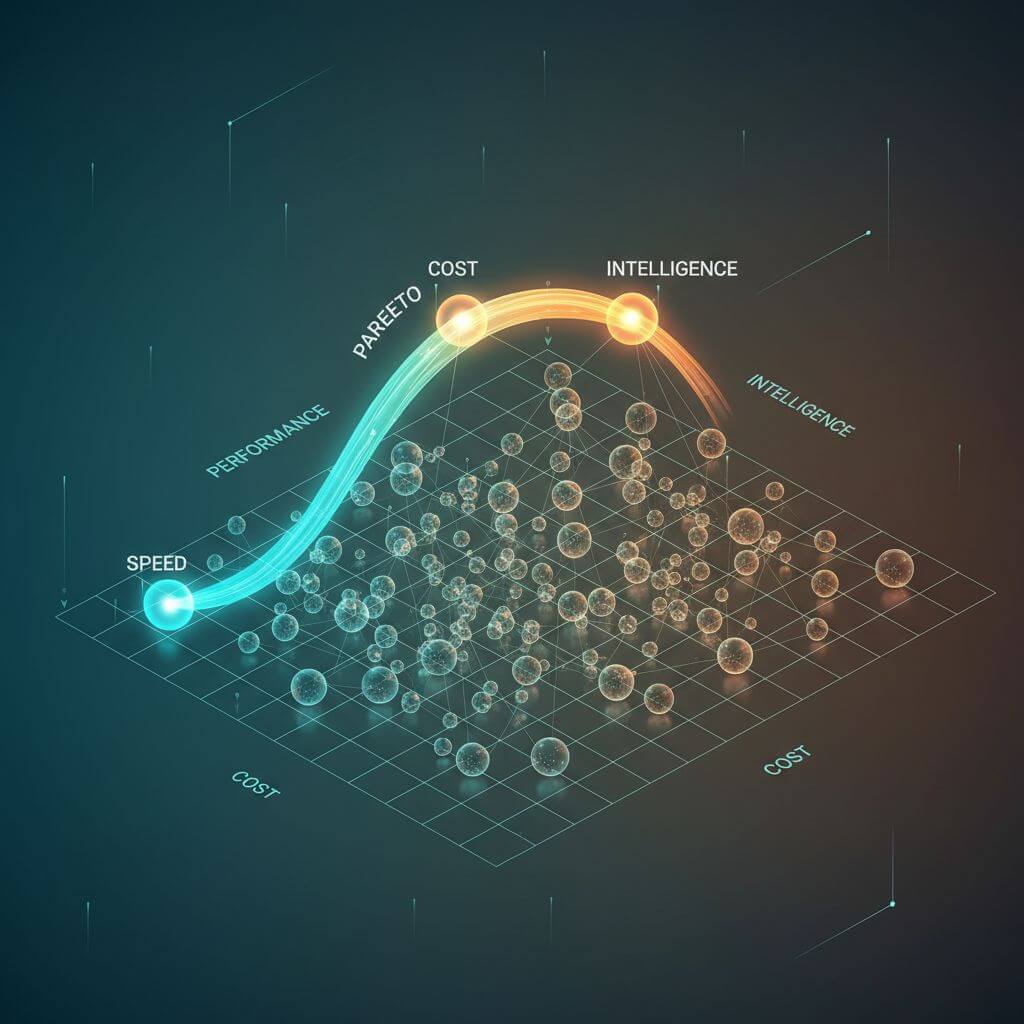

速度、智能与帕累托前沿

Gemini 3 Flash 展示了在不牺牲推理能力的前提下获取速度与规模。其在“性能—价格”坐标中的位置,体现出对帕累托前沿的强力推进:以更低成本、更低延迟实现更高性能。模型还可根据任务复杂度动态“调节思考深度”,在常规任务上更简洁,在复杂任务上加深推理。

关键效率点

- Token 效率:在典型流量场景下,完成日常任务平均可节省约 30% Token。

- 延迟:相较 Gemini 2.5 Pro,延迟降幅显著(测试显示可快约 3 倍),更适合高频迭代。

- 成本:输入 $0.50/百万 Token,输出 $3/百万 Token(音频输入为 $1/百万 Token)。

为开发者而建:编码、工具与多模态

Gemini 3 Flash 将专业级编码表现与低延迟结合,适用于代理式编码、生产级系统与高响应交互应用。

编码基准与代理工作流

- 在 SWE‑bench Verified 上取得 78% 成绩,超过 2.5 系列,甚至优于 Gemini 3 Pro(以该基准计)。

- 迭代开发流程受益于近实时的往返速度,代理更稳定高效。

多模态推理的实践价值

- 覆盖视频理解、数据抽取、视觉问答等场景,具备强推理与工具调用能力。

- 实时演示包括:游戏内助手、快速 A/B 测试、多步骤的设计‑到‑代码流水线等。

- 能基于单一指令生成多版设计,并对包含 UI 语境的图像做近实时分析,将静态图转为可交互体验。

企业落地反馈

来自 JetBrains、Bridgewater Associates、Figma 等公司的早期反馈显示,Gemini 3 Flash 在推理、效率、速度上的综合表现可与体量更大的模型相媲美,具备投入生产的可行性。

面向所有人:Gemini 应用与搜索默认启用

Gemini 3 Flash 正在全球范围内作为 Gemini 应用与搜索 AI 模式的默认模型上线,以更快、更强的多模态推理升级日常体验。

你可以这样用

- 在几秒内理解短视频与图像,例如分析高尔夫挥杆并生成练习计划。

- 边画边识别:边画草图边得到猜测结果,速度可跟上手势节奏。

- 上传音频获取个性化学习方案:定位知识盲区、生成定制测验,并附详细讲解。

- 用语音从零搭建小应用:口述想法,系统在数分钟内生成可运行原型。

搜索体验的推理进化

基于 Gemini 3 Pro 的推理能力,Gemini 3 Flash 在搜索 AI 模式中能更好解析问题细节,提供结构化、可视化、可行动的回答。它整合实时本地信息与网页链接,实现从检索到行动的一步直达,非常适合临时旅行规划或快速掌握复杂概念。

接入与定价

- 接入方式:Gemini API(Google AI Studio)、Google Antigravity、Gemini CLI、Android Studio、Vertex AI 与 Gemini Enterprise。

- 定价:输入 $0.50/百万 Token;输出 $3/百万 Token;音频输入 $1/百万 Token。

- 面向用户:Gemini 应用与搜索 AI 模式作为默认模型向全球逐步开放,免费可用。

常见问题

与 Gemini 2.5 Pro、Gemini 3 Pro 的差异?

Gemini 3 Flash 以更低延迟和更低成本提供前沿级推理表现。它在多项基准上超越 2.5 Pro,并在 MMMU Pro 上达到 81.2%,与 Gemini 3 Pro 相当,同时更适合速度优先的场景。

“调节思考深度”是什么意思?

模型会随任务复杂度动态调整推理长度:复杂任务更深入思考,日常任务则更简洁,从而在保证准确度的同时降低 Token 与延迟。

是否适合多模态任务?

是的。视频理解、图像分析(含上下文 UI 覆盖)、视觉问答等任务都得到强化,支持游戏内助手、快速 A/B 测试等实时应用。

如何使用?价格如何?

开发者可在 Google 的工具与云平台中使用(例如 Google AI Studio、Vertex AI 等)。价格为输入 $0.50/百万 Token、输出 $3/百万 Token(音频输入 $1/百万 Token)。

是否已对普通用户开放?

是。Gemini 3 Flash 正作为 Gemini 应用与搜索 AI 模式的默认模型全球上线,免费可用。

结语

Gemini 3 Flash 将前沿推理能力压缩进更快、更实惠的形态,持续推动“性能—成本—速度”的帕累托前沿。无论是开发者还是普通用户,都能借此获得近实时、多模态、可行动的智能体验,开启新一轮产品与工作流创新。